嵌入式技术与人工智能 融合趋势与应用软件开发新范式

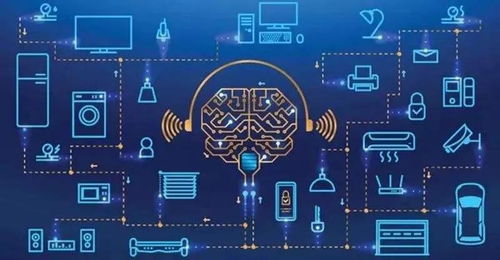

嵌入式技术与人工智能(AI)的关系正日益紧密,两者从最初的并行发展到如今的深度融合,共同推动着智能革命向物理世界的纵深发展。它们的关系可以概括为:嵌入式系统为AI算法提供了无处不在的物理载体和实时响应平台,而AI则为嵌入式设备赋予了感知、决策与学习的“智能大脑”,使其从传统的执行控制单元演变为自主智能体。

具体而言,传统嵌入式系统以微控制器/处理器为核心,专用于特定控制任务,强调实时性、可靠性与低功耗。人工智能,特别是机器学习(ML)和深度学习(DL),则擅长处理复杂模式识别与预测。二者的结合,即“嵌入式AI”或“边缘AI”,意味着将经过优化的小型化AI模型直接部署在嵌入式设备端进行推理(有时甚至是训练),而非完全依赖云端。这带来了显著优势:低延迟响应(本地处理,无需网络往返)、数据隐私保护(敏感数据无需上传)、网络带宽节约以及更高的系统可靠性(不完全依赖网络连接)。

发展趋势方面,呈现以下鲜明特点:

- 边缘计算的崛起与AI芯片的专用化:为满足端侧AI对算力与能效的极致要求,专用的AI加速芯片(如NPU、TPU)正集成到嵌入式SoC中。这些芯片针对矩阵运算等AI核心计算进行硬件优化,在功耗受限下提供强大推理能力。

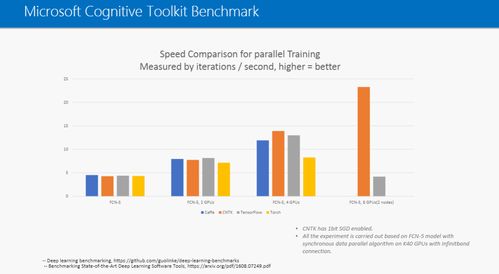

- 模型轻量化与优化技术成为关键:直接在资源受限的嵌入式设备上运行大型神经网络是不现实的。因此,模型剪枝、量化、知识蒸馏、神经架构搜索等模型压缩与优化技术是嵌入式AI落地的核心技术路径,旨在用更小的模型尺寸和计算量保持较高精度。

- “感知-决策-控制”一体化智能闭环:嵌入式AI正从单点应用(如视觉识别)向集环境感知、实时分析、自主决策与精准控制于一体的完整智能系统发展。这在自动驾驶汽车、自主机器人、工业质检与预测性维护中表现得尤为突出。

- 开发工具链与生态的成熟:为了降低开发门槛,主流芯片厂商和AI框架(如TensorFlow Lite for Microcontrollers, PyTorch Mobile, NVIDIA Jetpack)都提供了面向嵌入式平台的完整工具链,支持从模型训练、转换、优化到部署的全流程。

针对人工智能应用软件开发,在嵌入式领域也产生了新范式:

- 开发流程的转变:传统的嵌入式软件开发以C/C++为主,聚焦底层驱动和业务逻辑。嵌入式AI应用开发则更多采用“跨栈协同”模式:算法工程师在云端用Python训练和优化模型,软件工程师则负责将优化后的模型集成到嵌入式C/C++环境中,并处理前后端的数据流、资源管理和系统调度。MLOps(机器学习运维)理念也开始向边缘端延伸。

- 核心关注点:开发者需重点关注:

- 性能与资源的平衡:在算力、内存、功耗的严格约束下实现最佳AI性能。

- 实时性保证:确保AI推理任务能满足系统的硬实时或软实时截止期限。

- 跨平台部署与适配:使AI模型能高效运行在不同架构(ARM Cortex-M/A, RISC-V等)和不同厂商的芯片上。

- 安全性:包括数据安全、模型安全和系统安全,防止恶意攻击。

- 典型应用场景与开发:

- 智能视觉:基于摄像头的人脸识别、物体检测、缺陷分析。开发涉及使用OpenCV、嵌入式DL推理框架处理图像流。

- 智能语音:本地语音唤醒、指令识别、降噪。开发需处理音频信号采集、前端处理及轻量级语音模型(如RNN, CNN)部署。

- 预测性分析与控制:在工业设备上通过传感器数据(振动、温度)预测故障,或实现智能节能控制。开发通常涉及时序数据分析与轻型ML模型(如决策树、轻量级RNN)的集成。

嵌入式技术与人工智能的融合已是大势所趋,正驱动万物从“互联”走向“智联”。对于开发者而言,这要求既理解嵌入式系统的硬件特性与实时软件设计,又掌握AI模型的基本原理与部署优化技能。随着芯片算力的持续提升、算法的进一步高效化以及开发工具的不断完善,嵌入式AI应用软件开发将变得更加高效和普及,赋能千行百业,创造无处不在的智能体验。

如若转载,请注明出处:http://www.cqxzlc.com/product/10.html

更新时间:2026-05-29 00:19:44